◇未来,多模态大模型将和搜索引擎、知识图谱、博弈对抗、脑认知等技术进一步融合互促,朝着更智能、更通用的方向发展,应对更加复杂丰富的环境、场景和任务

◇大模型基于深度神经网络,为黑盒模型,在语言大模型的涌现能力、规模定律,多模态大模型的知识表示、逻辑推理能力、泛化能力、情景学习能力等方面,还存在一些盲区和薄弱环节,相关技术有待持续突破

◇积极推进云计算平台建设,打造以算力网络为核心的新型基础设施,以网强算,提供强大算力资源和相应服务

文 |《瞭望》新闻周刊记者 张玉洁

当前,众多科技企业都在围绕人工智能(AI)大模型扩张商业版图。

“大模型正产生着史无前例的影响力。从趋势看,大模型的发展能够催生通用人工智能,将引领千行百业数智化创新发展。”中国工程院院士、湘江实验室主任、湖南工商大学党委书记陈晓红告诉《瞭望》新闻周刊记者。

大模型经过大规模数据训练后,能够适应一系列任务,具有参数规模大、训练数据规模大和算力消耗需求大等特点。尽管技术发展突飞猛进,但仍受到可靠性差、训练数据依赖、因果推理能力弱、搭建成本高等的制约,并面临寻找合适落地场景的挑战。

近年来,陈晓红率领团队在先进计算与人工智能领域取得了一批原创性、系统性成果,并在大模型技术上积极探索。“我们将以强基础、促应用、保安全的思路推动发展,以体系化工程思路进行科技攻关。”陈晓红说。

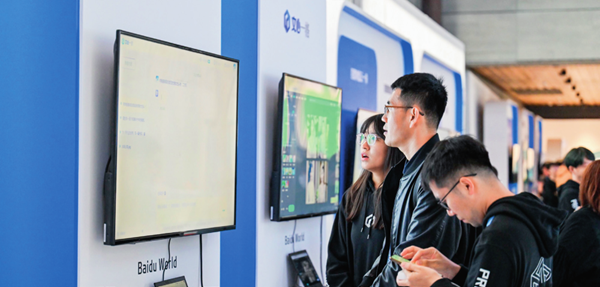

在百度世界大会2023 现场,参会者在展区试用百度“文心 一言”

(2023 年 10 月17 日摄) 张漫子摄 / 本刊

把握AI大模型发展生态和趋势

《瞭望》:AI大模型经历了怎样的发展历程?

陈晓红:就发展速度而言,超级智能的到来比我们想象的更快。当前,AI技术已步入了大模型时代,并成为了全球创新的焦点。

自2006年神经网络有效学习获得重要的优化途径至今,基于深度学习的AI技术研究范式,经历了从小数据到大数据,从小模型到大模型,从专用到通用的发展历程。2022年底,依托“大模型+大数据+大算力”加持的语言大模型ChatGPT,具备了多场景、多用途、跨学科的任务处理能力。这类大模型技术能广泛应用于经济、法律等众多领域,在全球范围掀起了大模型发展热潮。

大模型技术本身的发展也经历了架构演进统一、训练方式转变、模型高效适配等过程,且正由单一模态的语言大模型,向融合语言、视觉、听觉等多模态的大模型发展。数据显示,过去5年,参数量超过百亿的大模型全球已有45个左右。

我国在大模型领域拥有良好基础,具有强烈需求,具备广阔市场。近年来,国产大模型加速发展,“文心一言”在半年时间内迭代到了4.0版本,其理解、生成、逻辑、记忆四大能力都有显著提升。数据显示,我国有至少130家公司研究大模型产品,其中通用大模型78家,100亿级参数规模以上的大模型超过10个,10亿级参数规模以上的大模型已近80个,大模型数量位居世界第一梯队。

湘江实验室作为聚焦先进计算与人工智能领域的高能级科创平台,正集中力量在大模型领域积极攻关,力争早日推出面向行业领域的“轩辕”大模型,赋能智慧交通、智能制造、智慧医疗和元宇宙等行业产业高质量发展。

《瞭望》:怎样评价大模型在技术创新和落地应用方面的发展趋势?

陈晓红:当前,大模型“基础设施—底层技术—基础通用—垂直应用”的发展路线逐渐清晰。大模型技术生态正蓬勃发展,其主流趋势是开源服务与开放生态。得益于国内外大模型开放平台、开源模型、框架、工具与公开数据集等,大模型技术正加速演进。

大模型服务平台方面,向个人开放及商业落地应用延伸是主要趋势。如用户可以通过OpenAI API这一服务平台,访问不同的深度学习模型,进而完成下游任务。

在大模型开源生态方面,得益于开源框架的有效支撑,大规模模型的训练日趋成熟。例如飞桨作为国产的深度学习平台,集深度学习核心框架、基础模型库、端到端开发套件、工具组件于一体,可在自然语言处理、计算机视觉等多个领域模型的分布式训练中发挥重要作用。

大模型技术与实体经济加速融合,应用场景十分广泛。例如大模型+教育可以让教育方式更智能、更个性化;大模型+医疗能够赋能医疗机构的诊疗全过程;大模型+娱乐能够通过增强人机互动提升趣味性和娱乐性等等。正是在与教育、医疗、传媒艺术等千行百业的深度融合中,通用大模型的能力边界不断拓广,改变着人类社会的生产生活方式。

总之,大模型+软硬件+数据资源的上游发展生态势头强劲,大模型+应用场景的下游应用生态层出不穷,大模型正加速在全产业智能升级中形成关键支撑。未来,多模态大模型将和搜索引擎、知识图谱、博弈对抗、脑认知等技术进一步融合互促,朝着更智能、更通用的方向发展,应对更加复杂丰富的环境、场景和任务。我们要抢抓重要机遇,加快大模型更好赋能千行百业的步伐。

认清AI大模型发展的风险与挑战

《瞭望》:当前AI大模型发展还面临哪些挑战?

陈晓红:随着大模型日趋广泛的部署应用,带来的风险与挑战不容忽视,需引起高度关注。

首先,可解释性仍然存在不足。大模型基于深度神经网络,为黑盒模型,在语言大模型的涌现能力、规模定律,多模态大模型的知识表示、逻辑推理能力、泛化能力、情景学习能力等方面,还存在一些盲区和薄弱环节,相关技术有待持续突破。

其次,可靠性保障有待提升。基于海量数据训练的语言大模型,其合成内容在事实性、时效性等方面存在较多的问题,尚无法对所合成内容做出可靠评估。同时,大模型可能吸收和反映数据中存在的不当、偏见或歧视性等内容,从而产生仇恨辱骂、偏见歧视以及误导性的输出。

第三,部署代价高、迁移能力不足亟需解决。大模型的参数规模和数据规模非常巨大,训练和推理的算力需求量大、功耗高、应用成本高,而且端侧推理存在延迟等问题,这些限制了它的落地应用。同时,大模型作用的发挥依赖训练数据所覆盖的场景,依赖数据规模、广度、质量和精度。由于复杂场景数据不足、精度不够,大模型存在特定场景适用性不足的问题,面临泛化性等挑战。

第四,安全与隐私保护待加强。数据投毒攻击、模型窃取攻击、对抗样本攻击、指令攻击、后门攻击等多种攻击方式,对大模型相关应用部署造成隐患。同时,在大模型训练过程中,各类敏感隐私数据可能被编码进大模型参数中,存在通过提示信息诱发隐私数据泄露的可能。

第五,伴生技术风险需警惕。语言大模型与语音合成、图像视频生成等技术结合,可以产生人类难以辨别的音视频等逼真多媒体内容,可能会被滥用于制造虚假信息、恶意引导行为,诱发舆论攻击,危害国家安全。

推动AI大模型更好赋能千行百业

《瞭望》:如何推动大模型服务经济社会高质量发展?

陈晓红:应抓紧推动大模型技术研发,强化垂直行业数据基础优势,同时加强对大模型的风险监督,彰显AI的技术属性和社会属性。具体有以下建议:

一是推动大模型技术栈自主可控。首先,加强宏观规划和顶层设计,制定大模型发展纲要。加强在大模型核心环节和相关技术上的知识产权布局。积极组建包括由芯片、云计算、互联网、应用等上下游企业组成的产业发展联盟,支持产学研三方协同的大模型研发模式,鼓励相关企业基于大模型进行数字化转型升级。其次,加强大模型原始技术创新和大模型软硬件生态建设,提升大模型构建所需基础软件的自主可控性,鼓励企事业单位在开展大模型训练和推理时,更多使用国产深度学习框架;引导国产芯片厂商基于国产框架开展与大模型的适配和融合优化。

二是破解大模型训练过程中算力紧缺问题。首先,支持推动分布式计算技术的研究创新,提高算力的可扩展性和效率,促进产生计算集群,从而形成更大规模的计算能力。其次,积极推进云计算平台建设,打造以算力网络为核心的新型基础设施,以网强算,提供强大算力资源和相应服务;通过实施资金支持、税收优惠、知识产权保护等激励措施,鼓励企业和研究机构投资和研发与大模型算力相关的技术和设施,形成支撑大模型发展的强大基础。

三是技术驱动提升大模型的安全性。首先,设计系统的分类法,研究集成大模型应用中的潜在漏洞,有针对性地应对信息搜集、入侵、内容操纵、欺诈、恶意软件、服务可用性降低等攻击,研发大模型安全对齐、安全评估技术,发展大模型安全增强技术,提升训练数据的安全性,优化安全对齐训练算法,提高AI的鲁棒性和抗干扰性,不断提升透明性、可解释性、可靠性、可控性,逐步实现可审核、可监督、可追溯、可信赖。其次,加强对AI大模型发展的潜在风险研判和防范,对生成式AI服务实行包容审慎和分类分级监管,强化大模型安全监管措施;将伦理道德融入AI全生命周期,构建AI伦理治理标准体系,使模型的设计和训练严格遵循伦理准则。

四是构建大模型合规标准和评测平台。首先,制定AI的合规标准和开发指南,全面覆盖大模型的研发、训练和部署过程中的安全要求,制定相应的安全标准、准则,重点开展AI安全术语、AI安全参考框架、AI基本安全原则和要求等标准的研制;构建对大模型能力水平进行评估的方法体系,包括数据采集和使用的透明度和合法性,隐私保护措施,以及对敏感主题和内容的处理原则,确保大模型的研发应用符合道德和法律要求。其次,搭建科学有效的评测平台,制定一套针对中文背景下大模型评测的规范和方法论,明确评测过程中的数据准备、评估指标、测试方法等,并提供统一标准,依托平台开展针对不同领域和应用的多样化评测任务,从而准确研判不同模型的性能和效果。

五是构建协同推动大模型发展的机制。首先,探索加强学术界和企业界间常态化合作机制,鼓励高校和企业设立联合研究中心、实验室或合作项目,推动两者之间的数据共享和协同研究,以增进对大模型训练数据的理解和分析,帮助学术界更好地理解大模型的特性和潜在风险,帮助企业界进一步改进算法和模型的安全性。其次,促进优秀人才的培养和交流,通过建立博士生联合培养计划、研究人员赴企实地驻点访问等方式,促进校企之间拔尖人才的培养和交流。

(《瞭望》2023年第49期 )

链接:https://h.xinhuaxmt.com/vh512/share/11792063?d=134b422&channel=weixin